OpenClaw本地模型部署指南:高效运行与隐私保护详解

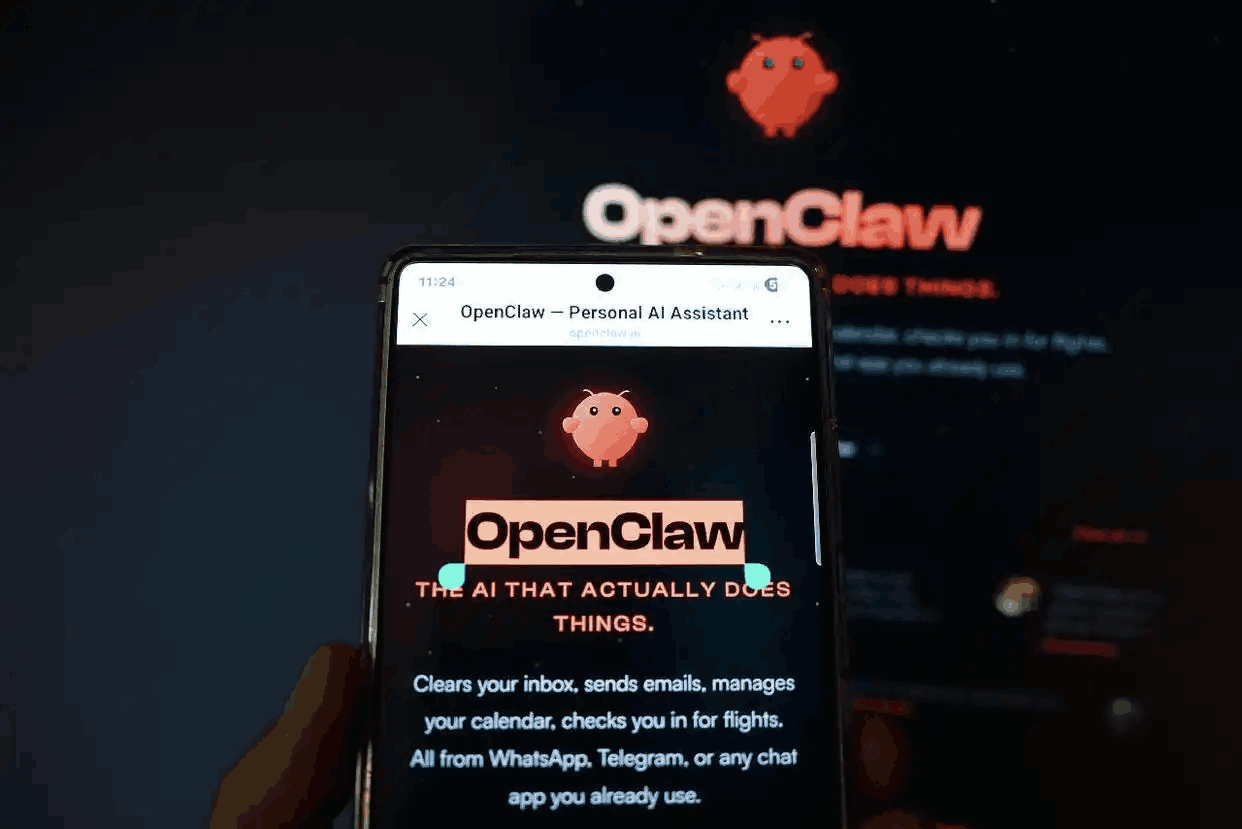

在人工智能技术飞速发展的今天,如何在保障数据隐私与降低延迟的同时,高效利用强大的AI模型,成为许多开发者和企业关注的焦点。OpenClaw作为一款新兴的开源模型,因其出色的性能而备受瞩目。本文将深入探讨OpenClaw本地模型的核心优势、部署流程及其带来的变革,为您提供一份实用的本地化部署指南。

将OpenClaw模型部署在本地服务器或个人计算机上,最直接的优势在于数据隐私的绝对掌控。所有数据处理和模型推理均在本地完成,敏感信息无需上传至云端,彻底规避了数据泄露的风险,这对于金融、医疗、法律等对数据安全要求极高的行业至关重要。其次,本地部署能显著降低网络延迟,模型响应速度取决于本地硬件性能,尤其对于需要实时交互的应用场景,能带来流畅无缝的用户体验。

成功部署OpenClaw本地模型需要清晰的步骤。首先,需要根据模型要求准备计算资源,通常需要配备足够显存的NVIDIA显卡、充足的内存和存储空间。随后,从官方仓库获取模型权重文件与源代码。在配置Python环境并安装必要的依赖库,如PyTorch或TensorFlow以及CUDA工具包后,即可加载模型并进行初步的推理测试。过程中可能遇到环境配置、依赖冲突等挑战,需要耐心排查。对于资源有限的用户,可以考虑量化技术或选择精简版的模型,以在性能与资源消耗间取得平衡。

本地化部署OpenClaw模型开启了广阔的应用前景。企业可以在此基础上构建内部智能知识库、自动化报告生成系统或定制化的客服助手。开发者则可以将其集成到离线应用程序中,创造出不受网络环境限制的智能产品。尽管一次性硬件投入和一定的技术门槛存在,但从长远来看,本地模型带来的自主性、安全性与成本可控性,使其成为许多组织AI战略中不可或缺的一环。

总而言之,OpenClaw本地模型的部署不仅是技术操作,更是迈向数据自主和高效智能的关键一步。随着开源生态的成熟和硬件成本的下降,本地AI模型必将赋能更多领域,推动人工智能技术在隐私保护的前提下更深入、更广泛地落地应用。